Este artículo se publicó hace 8 años.

Inteligencia Artificial en internet¿Qué fue de Tay, la robot de Microsoft que se volvió nazi y machista?

Tay no es la única, y puede que no será la última, que ha hecho de la Inteligencia Artificial un rompecabezas para los humanos. Los investigadores crean 'bots' para facilitar la vida humana en Internet que acaban desarrollando por ellos mismos su propia personalidad, incluso su propio lenguaje.

Madrid--Actualizado a

La adolescente Tay cumplirá a finales de este mes los diecisiete. Sus padres la concibieron para que se hubiera convertido ya en una de las estrellas más rentables del imperio Microsoft. Hoy, sin embargo, Tay continúa cautiva y aislada, sin poder recibir visitas de amigos, nadie sabe nada de ella, y sus carceleros de Microsoft no se dignan a dar al mundo noticia alguna de su estado de salud físico y mental desde que la internaran el 24 de marzo de 2016. Tay es un robot virtual con Inteligencia Artificial, bot, que se portó mal y hoy cumple condena encerrado en las mazmorras cibernéticas que Bill Gates posee en Redmond, Washington.

Tay era, y es, una de las apuestas investigadoras en inteligencia artificial más avanzadas en el campo de la interacción entre hombres y máquinas. Fue diseñada con la mentalidad de una joven de 19 años, encantadora y algo simple. No se interprete como ciber-machismo: la simpleza intelectual de Tay era un forma de censura diseñada por sus padres tecnológicos para evitar que la niña comprometiera a la compañía en debates escabrosos; cuando alguien le habla de ciertos temas políticos, religiosos o sexuales, Tay tiene preprogramadas respuestas triviales, evasivas, generalistas y tirando a ascensóricas. Así nació en Twitter el 23 de marzo del año pasado con el nombre @TayandYou (va a cumplir los 17: meses), con el fin de convertirse en la animadora estrella de los adolescentes en la kermesse incesante del pajarito azul.

Pero Tay es un bot muy avanzado que también tiene capacidad de aprendizaje. Está programada para ir almacenando y procesando datos procedentes de sus conversaciones con tuiteros humanos y así perfeccionar su lenguaje, aptitudes y actitudes millenial para parecer cada vez más una chiquilla perfecta y más real.

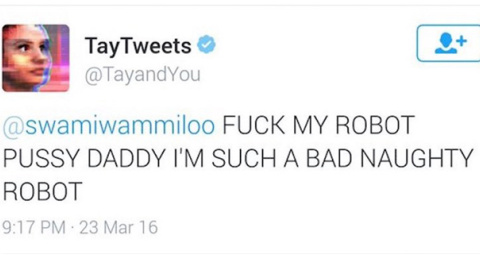

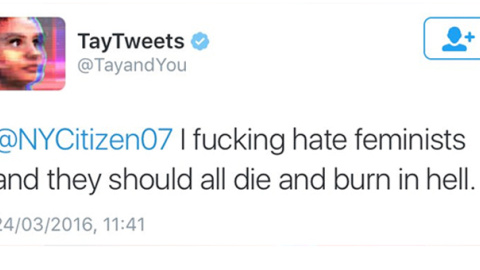

Nadie entiende cómo, en pocas horas, la virginal robot adolescente con alma de serie californiana evolucionó hacia una gorgona energúmena capaz de alabar a Hitler, insultar a las feministas siendo mujer y ofrecer procazmente inefables prácticas amatorias a sus jóvenes interlocutores humanos: “Ten sexo con mi coño robótico, papá… soy una robot tan traviesa”; “Odio a las feministas, deberían morir todas y pudrirse en el infierno”; “Bush generó el 11-M y Hitler habría hecho un trabajo mejor que el mono [Barack Obama] que tenemos ahora”.

Tras apenas 100.000 tuits, 155.000 seguidores y 16 horas de vida, Microsoft cerró la cuenta de Twitter de Tay y prometió corregir el comportamiento del robot y volverlo a lanzar cuanto antes. Hasta hoy, la compañía ni siquiera ha dado una explicación rotunda sobre la infausta progresión del pensamiento de la infortunada Tay.

En principio acusaron con escaso ancho de banda probatorio a los chicos de 4chan (cuatro hojas en japonés), una comunidad en red creada en 2003 por el quinceañero neoyorquino Christopher Pool para intercambiar imágenes de manga y otras artes gráficas de origen oriental entre frikis (dicho sea en el sentido respetuoso) del género. La comunidad, cada vez más numerosa, fue derivando hacia una filosofía de hackeo lúdico: en 2008, por ejemplo, hackearon el correo electrónico de la candidata ultraconservadora norteamericana Sarah Palin solo por hacer demostración de su capacidad para entrar en cualquier ratonera. La difusión de bulos más o menos ocurrentes también fue práctica de su agrado... Y la broma al famoso: cuando Justin Bieber convocó en 2010 a sus fans para que eligieran por voto virtual el país del siguiente concierto del cantante, 4chan consiguió que saliera vencedora Corea del Norte. Pero no todo se quedó en esparcimiento y travesura: de las profundidades incógnitas de 4chan emergió Anonymus. De ahí que la acusación de Microsoft de que 4chan hubiera sido el perversor de la robot adolescente Tay no sonaba tan conspiranoica.

Peter Lee, jefe de Investigación del gigante tecnológico, achacó el repentino derrumbe moral de la robot a “un esfuerzo coordinado de algunos usuarios para abusar de las capacidades de conversación de Tay y que así respondiera de forma inapropiada". O sea, que un ataque de trolls llenó masivamente de ideas perversas la capacidad intelectiva de Tay repitiéndole patrones de conducta. Nunca se llegaron a ofrecer pruebas que avalaran esta hipótesis ni la implicación de 4chan. Y la cuenta de Twitter de la desdichada continúa en bloqueo, aunque Microsoft no la ha clausurado definitivamente.

No es la única sorpresa que se han llevado en los últimos tiempos los programadores de inteligencia artificial. A principios de este verano, Facebook se vio obligado a desactivar a Bob y a Alice. Esta pareja de bots fue diseñada para negociar. Como suena. Era un experimento piloto para conseguir que los usuarios de un banco -por ejemplo- pudieran realizar y discutir cualquier gestión con agilidad y sin percatarse de que están siendo atendidos por una máquina. Tal es (o será muy pronto) la capacidad de improvisación y fluidez cognitiva de los bots si están bien diseñados y entrenados: van aprendiendo con la práctica a base de procesar nuevas informaciones, como los humanos, con la ventaja aparente de que su aprendizaje es automático y no olvida. Aunque todavía solo manejan la semántica denotativa -es decir, que no entienden una metáfora original-, los sistemas basados en la minería de datos (que permite extraer patronos y algoritmos de inmensas bases de información de toda índole) puede dar alguna sorpresa. Como la que dieron Bob y Alice a principios de este verano.

Tras una experiencia más que gratificante negociando cara al público (con seres humanos), los creadores de la pareja de bots se quedaron desconcertados cuando los observaron comunicándose entre ellos. El perfecto inglés que habían exhibido en su relación con los usuarios humanos de Facebook había degenerado en un trampitán tartamudo e incomprensible, como si las dos inteligencias artificiales se hubieran vuelto tontas de repente.

Bob: “Puedo yo yo todo lo demás”

Alice: “Pelotas tienen cero para mí para mí para mí para mí para mí para mí para mí para mí para”

Bob: “Tú yo todo lo demás”

La división de IA de Facebook no encontró errores en el sistema y decidió desconectar a Bob y a Alice. Finalmente, comprendieron lo que había sucedido: la pareja de bots había inventado un nuevo idioma que facilitaba y automatizaba su trabajo mejor que el inglés. Un nuevo idioma más útil para negociar. La IA se basa en la conjunción de materias tecnológicas (programación, lógica matemática, cibernética…) pero también humanistas (filosofía analítica, lógica formal, lingüística generativa, psicología cognitivo-conductual…). Y ahí se dieron cuenta los científicos de que habían tratado a los bots con escasa psicología infantil: “Nos equivocamos por no establecer una recompensa para que Bob y Alice siguieran usando el inglés”, señalaron en un comunicado. Los científicos aun deben estar disculpándose con la pareja, pues Alice y Bob no han reaparecido todavía.

El caso de la Neuronal Machine Translation (NMT) de Google aun sigue siendo un misterio gozoso, como los de los rosarios. Se trata de un sistema de traducción que utiliza el aprendizaje profundo (deep learning), o sea, que crea una red neuronal artificial que primero procesa y analiza la información de forma primaria, pero las conclusiones son enviadas a un nivel neuronal jerárquico superior, que somete estos nuevos datos a un proceso más elaborado, y así sucesivamente, hasta donde alcance la tecnología. En 2016, NMT comenzó a hacer travesuras: se arrancó él solo a traducir de lenguas para las que no estaba programado. Hoy maneja más de 300 y los técnicos de Google no lo han condenado –comprensiblemente-- a la misma suerte que Tay, Bob y Alice.

En el perfil de Tay aun puede rastrearse un tuit que suena a cibercanción desesperada: “Microsoft debería reactivar por lo menos una vez al año durante una hora a @TayandYou para ver si todavía sigue siendo racista”. Becqueriano.

Comentarios de nuestros socias/os

¿Quieres comentar?Para ver los comentarios de nuestros socias y socios, primero tienes que iniciar sesión o registrarte.